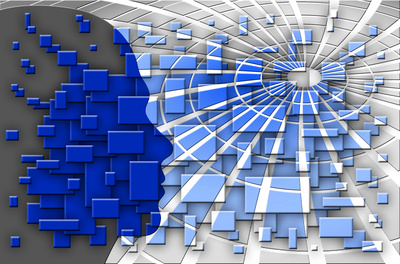

Künstliche Intelligenz verspricht Lösungen für viele Probleme der digitalisierten Welt. Kann sie helfen, die Eskalation von Hassrede im Internet zu verstehen?

Seitdem populistische Bewegungen und Akteure die politische Auseinandersetzung in die sozialen Medien gezogen haben, wird dort mit harten sprachlichen Bandagen gekämpft. Beleidigungen, Verleumdungen und Diskriminierungen sind in den Kommentarspalten an der Tagesordnung. Dies gilt besonders für Themen, die gesellschaftlich umstritten sind und diffuse Ängste befeuern: Migration, Religion, kulturelle Werte, soziale Gerechtigkeit. So explodiert etwa die Kommentierung zum Thema Flucht und Asyl regelmäßig und wird häufig nur durch Abschalten und Löschen aufgehalten.

Seitdem populistische Bewegungen und Akteure die politische Auseinandersetzung in die sozialen Medien gezogen haben, wird dort mit harten sprachlichen Bandagen gekämpft. Beleidigungen, Verleumdungen und Diskriminierungen sind in den Kommentarspalten an der Tagesordnung. Dies gilt besonders für Themen, die gesellschaftlich umstritten sind und diffuse Ängste befeuern: Migration, Religion, kulturelle Werte, soziale Gerechtigkeit. So explodiert etwa die Kommentierung zum Thema Flucht und Asyl regelmäßig und wird häufig nur durch Abschalten und Löschen aufgehalten.

Zwei Fragen sind dabei weitgehend ungeklärt und rücken zunehmend in das Blickfeld der Forschung: Welche kommunikativen Mechanismen stecken hinter dieser sprachlichen Eskalation von Wut und Hass? Und: Wie verlaufen eigentlich die Beobachtungs- und Entscheidungsprozesse bei denjenigen, die in der Pflicht sind, Hassreden und persönliche Herabsetzungen aus „ihren“ Kommentarspalten herauszuhalten?

Vielversprechende Forschungsansätze

In jüngster Zeit gibt es zur Untersuchung dieser Fragen vielversprechende Forschungsansätze, die auf der Basis großer Datensätze aus den sozialen Online-Medien versuchen, diese Mechanismen mithilfe künstlicher Intelligenz zu verstehen. Die finnische Kommunikationswissenschaftlerin Salla-Maaria Laakson hat dazu erste Ergebnisse einer Forschungsgruppe von der Universität Helsinki zur automatischen Erkennung rassistischer Äußerungen in politischen Debatten vorgelegt.

Computerlinguisten, Informatiker und Kommunikationswissenschaftler entwickeln Algorithmen für die Erkennung wiederkehrender Muster der Eskalation und ihrer bisher wenig transparenten Verarbeitung in den Arbeitsgruppen der Social-Media-Plattformen. Die „lernende“ Maschine kann bei der Entdeckung dieser Mechanismen helfen und bei der Moderation der politischen Debatten im Netz helfen – so Hypothese und Versprechen der Künstlichen Intelligenzforschung.

Pete Burnap /Matthew L. Williams (2015): Cyber Hate Speech on Twitter: An Application of Machine Classification and Statistical Modeling for Policy and Decision Making https://doi.org/10.1002/poi3.85

Freie Universität Berlin: NoHate – Bewältigung von Krisen öffentlicher Kommunikation im Themenfeld Flüchtlinge, Migration, Ausländer http://www.polsoz.fu-berlin.de/kommwiss/v/bmbf-nohate/index.html

Universität Helsinki: Racisms and public communications in the hybrid https://tuhat.helsinki.fi/portal/en/projects/racisms-and-public-(5ffef4d6-5926-446e-b566-9dfb8cac4040).html

Bildquelle: pixabay.de

Schlagwörter:Hassrede, Internet, Kommentare, künstliche Intelligenz, Populismus