Reguliert Künstliche Intelligenz nicht, sonst können wir eure Probleme nicht lösen, fordert Mark Zuckerberg. Damit versucht der Facebook-Chef dem politischen Druck entgegenzuhalten, der mit der Forderung nach Regulierung digitaler Medienplattformen immer stärker auf dem Unternehmen lastet.

Technologie ist weder gut noch böse – noch ist sie neutral. Dieses „Erste Technologiegesetz“ hat der Technologiehistoriker Melvin Kranzberg vor 33 Jahren formuliert – und es trifft nach wie vor zu. Erst die Gesellschaft deutet und wertet Technologie. Und das macht neue Technologien nutzbar – oder eben nicht.

Technologie ist weder gut noch böse – noch ist sie neutral. Dieses „Erste Technologiegesetz“ hat der Technologiehistoriker Melvin Kranzberg vor 33 Jahren formuliert – und es trifft nach wie vor zu. Erst die Gesellschaft deutet und wertet Technologie. Und das macht neue Technologien nutzbar – oder eben nicht.

Eine neue Technologie, die wegweisend für unsere unmittelbare Zukunft sein soll, ist Künstliche Intelligenz (KI). Sie lässt Autos selbstständig fahren, verbessert Krankheitsdiagnosen und erzeugt Kunstwerke. Doch auch die algorithmischen Empfehlungsdienste digitaler Plattformen basieren auf tiefgehendem maschinellem Lernen, also KI. Und diese Empfehlungsdienste stehen aktuell in der Kritik. Allen voran die von Facebook, aber auch von Google, YouTube und Twitter.

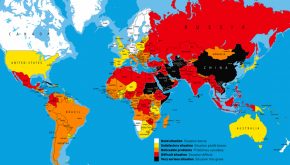

Spätestens seit den US-amerikanischen Präsidentschaftswahlen 2016 und dem Cambridge-Analytica-Datenskandal 2018 ist es ins öffentliche Bewusstsein gelangt: Die Technologie und die Marktmacht digitaler Plattformen bergen negative Folgen für demokratische Gesellschaften. Digitale Plattformen selektieren, priorisieren und filtern nach ihren eigenen, undurchsichtigen Regeln. Dabei machen sie es einfach, Desinformation und diskriminierende Werbung zu verbreiten oder gegen Minderheiten zu hetzen. Entsprechend werfen Kommunikations- und Wirtschaftswissenschaftler*innen Facebook und Co. reines Profitstreben und Verantwortungslosigkeit vor. Die Wirtschaftswissenschaftlerin Shoshana Zuboff beschreibt das Verhalten digitaler Plattformen als „Überwachungskapitalismus“: Durch digitale Überwachung digitaler Plattformen wird menschliches Verhalten analysiert, kategorisiert und monetarisiert. Die potenziell gute Technologie hat einiges an Glanz eingebüßt.

Die besondere Marktmacht digitaler Plattformen besteht darin, dass sie Meinungen beeinflussen können. Diese Macht haben digitale Plattformen ungewollt durch ihre intermediäre Stellung zwischen Inhaltsanbietenden und Nutzenden gewonnen und verwenden sie nun zur Profitgenerierung.

Die Darstellung digitaler Plattformen als mächtige, aber verantwortungslose Akteure kann für sie schwerwiegende Folgen haben.

Die Fähigkeit, Meinungen in diesem Ausmaß zu beeinflussen, besaßen in der Vergangenheit nur Medienunternehmen – und die standen unter regulativer Aufsicht. Ihr Auftrag und ihre publizistische Leistung wurden öffentlich diskutiert. Eine solche Diskussion erleben digitale Plattformen bereits. Die Regulierung steht ihnen wenn schon erst noch bevor. Dabei geht manchen die Regulierung viel zu langsam voran.

Die Darstellung digitaler Plattformen als mächtige, aber verantwortungslose Akteure kann für sie schwerwiegende Folgen haben. Denn solche nicht-technischen, „menschlichen“ Faktoren bestimmen Regulierungsentscheidungen laut dem Kranzbergschen „Vierten Technologiegesetz“ (Kranzberg, 1986). Ein wesentlicher nicht-technischer Aspekt sind laut Kranzberg Befürchtungen von Umweltschäden. Digitale Plattformen befinden sich inmitten ihrer nichttechnischen Bewertung, bei der statt Umweltschäden Befürchtungen von Demokratieschäden im Zentrum stehen: In einem Bericht des britischen Parlaments zu „Disinformation und fake news“ wird von der „Entführung unseres Verstands und unserer Gesellschaft“ (Original: „hijacking our minds and society“) durch digitale Plattformen gesprochen. – Und das scheint den digitalen Plattformen sehr bewusst zu sein.

Eine Regulierung hieße für digitale Plattformen, dass sie einer anderen Logik als jener des „Surveillance Capitalism“ folgen müssten. Da Anbieter wie Facebook oder Google eine Öffentlichkeit herstellen, was traditionell eine gesellschaftliche Funktion von Medien ist, werden Normen wie journalistische Qualität und Transparenz für digitale Plattformen relevant. Sich solchen Werten zu verschreiben, wird aufwändig und teuer und könnte sich durchaus negativ auf ihr Geschäft auswirken.

Die bisherige Strategie digitaler Plattformen nach Fehltritten beschreibt Shoshana Zuboff folgendermaßen: „Take without asking. Act surprised when challenged. Apologize. Repeat.“

#SurveillanceCapitalsim 101: Take without asking. Act surprised when challenged. Apologize. Repeat.https://t.co/YUOrC8q5V6

Learn all about it in this @Recode podcast. Thanks to the amazing @karaswisher for our hard-hitting conversation. https://t.co/zwO56PPMFt

— Shoshana Zuboff (@shoshanazuboff) 20. Februar 2019

Doch eine solche Strategie dürfte nicht mehr reichen, um Regulierung zu vermeiden.

Inzwischen haben Mark Zuckerberg, Sheryl Sandberg (Facebook), Jack Dorsey (Twitter) und Sundar Pichai (Google) eine Entschuldigungs-Runde vor dem US-amerikanischen Senat hinter sich gebracht. Zuckerberg wurde auch zum EU-Parlament eingeladen (Mai 2018). Dort ging es ihm offenbar hauptsächlich um die Darstellung von Facebook als verantwortungsbewusstes Unternehmen. Seine Rede fokussiert auf positive gesellschaftliche Effekte von Facebook, die Einsicht in eigene Fehler, sowie ihre Effizienz und Gewissenhaftigkeit bei der Fehlerbehebung.

Hier kommt die Künstliche Intelligenz ins Spiel. Denn Facebook gibt nun vor, mithilfe von KI die Probleme lösen zu können, die erst durch KI entstanden sind. Mark Zuckerberg hat KI in seiner Anhörung vor Vertreter*innen des EU-Parlaments als allmächtige Technologie dargestellt, die keinesfalls reguliert werden dürfe.

Mehr noch: In Zuckerbergs Darstellung ist KI die Lösung für alle Probleme – etwa zum Identifizieren von Terror-Inhalten, Fake-Profilen, aktueller Desinformation und Selbstmord-Videos. Zumindest scheint das ein Fernziel zu sein: Im Moment setzt Facebook noch „echte“ Menschen als Content-Moderator*innen ein, die nicht nur schlecht bezahlt werden, sondern auch unter miserablen Bedingungen arbeiten, wie „The Verge“ kürzlich aufzeigte.

Sicherheitshalber übte sich Zuckerberg noch in externer Schuldzuweisung: Man könne vorgängig nie abschätzen, was einzelne „böse“ User*innen sich ausdenken, um Facebooks System zu umgehen und für ihre Zwecke auszunutzen. Und dann noch ganz allgemein: Man solle nicht vergessen, wie wichtig Facebook als Wirtschaftsmotor für lokale Unternehmen ist und damit indirekt Arbeitskräfte schafft.

Mit zu viel Regulierung hätte Facebook damals nicht entstehen können, warnt Zuckerberg.

Nachdem Zuckerberg Facebook als verantwortungsbewusste Wirtschaftskraft und KI als Lösung für alle Probleme dargestellt hat, kommt sein zentrales Anliegen: Reguliert Künstliche Intelligenz nicht, sonst können wir eure Probleme nicht lösen. Dazu verwies Zuckerberg auf seine Situation als Student, der in seinem Wohnheim-Schlafzimmer Facebook entwickelt hat. Mit zu viel Regulierung hätte es das nicht gegeben. Und diese Regulierung sollten wir Künstliche Intelligenz nicht auferlegen. Sonst gäbe es keine Zuckerbergs von morgen. (Und das kann ja niemand ernsthaft wollen.)

Zuckerbergs Rede vor dem EU-Parlament lässt sich einerseits als strategische Unternehmenskommunikation begreifen. Zuckerberg gelobt Besserung und versucht strategisch, die angekratzte Legitimität von Facebook mittels moralischen Verantwortungsnarrativen und dem Betonen positiver gesellschaftlicher Folgen von Facebooks Services zu reparieren.

Durch die techno-libertäre Darstellung der Überlegenheit von Künstlicher Intelligenz kann Zuckerbergs Rede andererseits auch als sogenannte institutionsetablierende Arbeit verstanden werden: Er schreibt Künstlicher Intelligenz einen hohen gesellschaftlichen Nutzen zu und stellt sie damit in einem positiven Licht dar. Ganz im Sinne des Kranzbergschem Ersten Technologiegesetz. Damit trägt Zuckerberg dazu bei, dass KI als gesellschaftlicher Wert institutionalisiert wird: KI wird nützlich und damit wertvoll. Zuckerberg hat damit eine Grundlage für die sogenannte kognitive Legitimität von KI gelegt.

Das meint, KI zu einem Status zu verhelfen, bei der ihr Einsatz nicht mehr hinterfragt wird und stattdessen zur Selbstverständlichkeit wird. – Technologien und Organisationen erreichen ab und an diesen subtilen und zugleich machtvollen Status. Beispielsweise ist es undenkbar, eine akute Blinddarmentzündung anders zu behandeln als operativ. Oder historisch: Die katholische Kirche wurde vor der Reformation nicht in Frage gestellt. Das ist echte kognitive Legitimität. – Und diejenigen, die KI einsetzen, profitieren davon: KI poliert ihre Legitimität weiter auf. Und das möglicherweise noch zu einem günstigeren Preis als (schlecht bezahlte) Content-Moderator*innen. So kann die Zukunft für Facebook gar nicht schnell genug kommen.

Mit seiner aktuellen Kommunikation legt Zuckerberg eine Grundlage für die Verteidigung bei zukünftigen Fehltritten.

Mark Zuckerbergs Kommunikation hat damit zwei Fliegen mit einer Klappe geschlagen. Er verteidigt die Legitimität seiner Plattform und tritt für KI ein. Damit ist eine Grundlage für die Kommunikation bei zukünftigen Fehltritten gelegt. Zukünftig können Fehler nur auftreten, wenn boshafte User*innen ein Verhalten an den Tag legen, das das KI-System noch nicht kennt. Ich höre Mark Zuckerberg schon sagen: „Das hat unser KI-System damals noch nicht gekannt.“ Falls KI reguliert würde, hieße es: „Wir konnten unser KI-System nicht effektiv genug entwickeln.“

Nutzbar im Sinne von Kranzberg ist KI bereits heute. Haben bis dahin KI und ihre Art zu lernen einen Selbstverständlichkeits-Status erreicht, wird keine Schuldzuweisung zu Facebook möglich sein. Denn das KI-System hat versagt. Facebook dagegen hat alles in seiner Macht getan, was möglich war. Und eine Option, in der Menschen und ihr Denken statt KI als Problemlösung sinnvoll erscheint, ist nicht mehr denkbar. Dass andere Menschen als Programmierer*innen gesellschaftliche Probleme lösen, ist also nicht geplant.

Erstveröffentlichung: Medienwoche vom 7. März 2019

Bislang in der Serie erschienen:

Bildquelle: pixabay.com

Schlagwörter:Desinformation, digitale Plattformen, Facebook, Fake News, KI, künstliche Intelligenz, Mark Zuckerberg, Regulierung, Überwachung