Kann eine Maschine Wahrheit prüfen? Während generative KI immer leistungsfähiger wird, stehen Fact-Checker:innen vor einer grundlegenden Frage: Wie viel Verantwortung lässt sich an Algorithmen abgeben – und wo müssen klare Grenzen gezogen werden?

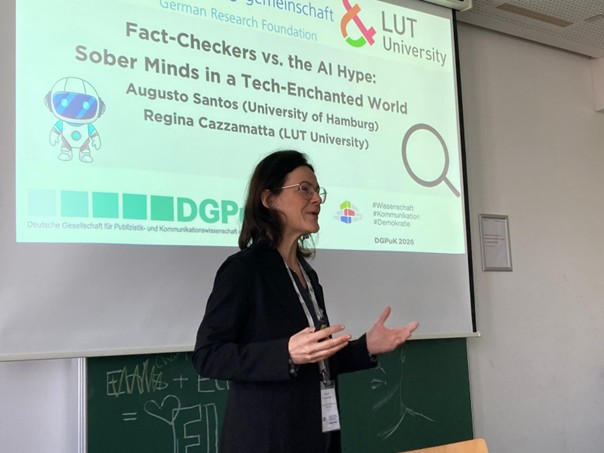

Prof. Regina Cazzamatta (LUT University) bei der Tagung in Dortmund, Foto: Susanne Fengler

Genau dieser Spannungsbogen prägte das Panel 22 „Fact-Checking, transnationale Praktiken und normative Orientierungen“ auf der 71. Jahrestagung der Deutschen Gesellschaft für Publizistik- und Kommunikationswissenschaft (DGPuK) an der TU Dortmund, die unter dem Motto „#Wissenschaft #Kommunikation #Demokratie“ stand. Im Panel diskutierten internationale Forscher:innen – Regina Cazzamatta von der LUT University, Augusto Santos von der Universität Erfurt sowie Katrin Wallner, Matthias Karmasin und Larissa Krainer von der Universität Klagenfurt -, wie sich Fact-Checking im Kontext von KI, globalen Netzwerken und normativen Standards verändert. Die Beiträge beleuchteten Fact-Checking aus unterschiedlichen Perspektiven – von KI-Anwendungen über transnationale Dynamiken bis hin zu normativen und organisatorischen Strukturen.

Im Zentrum standen aktuelle Forschungsarbeiten zur Frage, wie Fact-Checker:innen generative KI in ihre Arbeitsprozesse integrieren – und wo sie es bewusst nicht tun.

KI entlang des gesamten Verifikationsprozesses

Eines der vorgestellten Projekte analysiert den Einsatz von KI entlang von vier Phasen des Fact-Checkings: Monitoring, Recherche, Produktion und Distribution.

Dabei zeigt sich: KI wird zur Effizienzsteigerung bereits in allen Phasen eingesetzt. Beim Monitoring hilft sie durch die automatisierte Erkennung von Claims, oder die Transkription öffentlicher Kommunikation und Übersetzungen. In der Recherche fasst KI umfangreiche Dokumente zusammen und unterstützt bei der Verifikation und in der Produktion ist sie hilfreich für die Erstellung von Kurzfassungen und die Anpassung von Inhalten für verschiedene Plattformen. Auch bei der Distribution ist KI von Nutzen, indem sie für die gezielte Ausspielung von Korrekturen an zuvor exponierte Nutzer:innen sorgt. Gerade bei repetitiven und datenintensiven Aufgaben wird KI als deutliche Entlastung wahrgenommen.

Zwischen Faszination und Skepsis

Theoretisch wird diese Entwicklung im Panel mit dem Spannungsfeld von „Verzauberung“ und „Entzauberung“ beschrieben. Während KI zunächst als vielversprechende Innovation erscheint, relativieren Praktiker:innen diesen Eindruck im Arbeitsalltag deutlich.

Neben Effizienzgewinnen werden vor allem Probleme betont:

- Tools zur Erkennung KI-generierter Inhalte gelten als unzuverlässig

- Wahrscheinlichkeitsaussagen („60–70 % KI-generiert“) sind schwer vermittelbar

- Technische und finanzielle Anforderungen erschweren den Einsatz

Diese Ambivalenz prägt den praktischen Umgang mit den neuen Technologien.

Klare Grenze: Menschliche Verantwortung

Ein zentrales Ergebnis: Fact-Checker:innen lehnen es ab, KI als eigenständig handelnden Akteur zu betrachten. Stattdessen wird sie konsequent als unterstützendes Werkzeug eingeordnet. Die Interviews haben besonders die Notwendigkeit menschlicher Verantwortung für alle Inhalte hervor. Auch die große Bedeutung von Transparenz im Umgang mit KI wird betont. Dazu gehört auch ein reflektierter Umgang mit Bias und den Trainingsdaten des Programms. So verteidigen Fact-Checker:innen auch ihre professionelle Autorität gegenüber technologischen Entwicklungen.

Institutionelle Regeln spiegeln die Praxis

Die Studie vergleicht zudem individuelle Perspektiven mit organisatorischen Leitlinien aus 18 Fact-Checking-Organisationen. Das Ergebnis: Es gibt keine grundlegende Diskrepanz zwischen Praxis und institutionellen Vorgaben.

Auch die Leitlinien betonen die Bedeutung von menschlicher Aufsicht und Rechenschaftspflicht und die Wichtigkeit einer transparenten Nutzung von KI. Sie sprechen auch ethische Fragen an und halten dazu an, ein Bewusstsein für Risiken von KI-Nutzung zu entwickeln und zu erhalten. Außerdem enthalten sie häufig Verbote der automatisierten Produktion von Inhalten. Professionelle Normen im Umgang mit KI scheinen sich damit bereits zu stabilisieren.

Vorsichtige Integration statt technologischer Umbruch

Insgesamt zeigt das Panel ein differenziertes Bild: KI wird weder abgelehnt noch unkritisch übernommen. Stattdessen erfolgt eine selektive und kontrollierte Integration.

Drei zentrale Befunde lassen sich festhalten:

- KI wird zur Effizienzsteigerung genutzt – aber nicht zur Automatisierung journalistischer Entscheidungen.

- Menschliche Kontrolle bleibt zentral für die professionelle Identität.

- Normative Grenzen für den KI-Einsatz sind bereits klar formuliert.

Vor dem Hintergrund der Konferenz, die sich intensiv mit den Herausforderungen für Kommunikation und Demokratie im digitalen Wandel beschäftigte, macht das Panel deutlich: Der Einsatz von KI im Fact-Checking ist kein radikaler Bruch – sondern ein ausgehandelter, normativ gerahmter Prozess.

Schlagwörter:Desinformation, DGPuK, Fact Checking, Journalismusforschung, KI, künstliche Intelligenz