Das Konzept der sogenannten „Post-Faktizität“ – wonach objektive Fakten weniger Einfluss auf die öffentliche Meinung haben als Appelle an Emotionen und persönliche Überzeugungen – hat die digitale Informationslandschaft neu geprägt. In diesem Umfeld befindet sich Wikipedia an der Schnittstelle zwischen Vertrauen und Skepsis. Die Plattform ist zwar nach wie vor eine der weltweit meistgenutzten Informationsquellen, aber auch ein bevorzugtes Ziel für Manipulationen durch Akteur:innen, die das offene Bearbeitungsmodell für ideologische oder politische Zwecke ausnutzen wollen.

Misstrauen gegenüber Medien, Wissenschaft und Institutionen sind weit verbreitet. Dieser Vertrauensverlust ist kein Zufall, sondern wird von verschiedenen destabilisierenden Akteur:innen gefördert, die die Glaubwürdigkeit neutraler Wissensplattformen untergraben wollen. Das Ergebnis ist ein „korrupter Narrativmarkt“, auf dem sich Desinformation rasch verbreitet und Plattformen wie Wikipedia zu Schlachtfeldern eines umfassenderen Kultur- und Informationskriegs werden.

Wikipedia: Zielscheibe und Zufluchtsort für Informationsintegrität

Die einzigartige Position von Wikipedia als Crowdsourcing-Enzyklopädie macht sie anfällig für koordinierte Desinformationskampagnen. Im Gegensatz zu traditionellen Medien oder sozialen Netzwerken sind die Inhalte von Wikipedia ständig editierbar, was von böswilligen Akteur:innen ausgenutzt werden kann. Diese Offenheit macht sie jedoch auch zu einem Zufluchtsort für überprüfbares Wissen. Die Transparenz, Rückverfolgbarkeit und gemeinschaftsorientierte Verwaltung der Plattform bieten einen robusten Schutz vor Manipulationen. Verschiedene Grundsätze von Wikimedia bilden die Basis für die Abwehr von Desinformation:

- Ein neutraler Standpunkt (eng. NPOV): Die Grundprinzipien von Wikipedia verlangen, dass Artikel aus einer neutralen Perspektive geschrieben werden und alle wichtigen Standpunkte fair und unvoreingenommen darstellen. Dieser Grundsatz dient als natürlicher Schutz vor Desinformation, indem er sicherstellt, dass die Inhalte ausgewogen und gut recherchiert sind.

- Transparenz und Rückverfolgbarkeit: Jede Bearbeitung auf Wikipedia wird öffentlich protokolliert und ermöglicht somit vollständige Transparenz. Diese Rückverfolgbarkeit stellt sicher, dass jeder Versuch, Inhalte zu manipulieren, schnell erkannt und rückgängig gemacht werden kann.

- Gemeinschaftliche Verwaltung: Das dezentrale Verwaltungsmodell von Wikipedia befähigt eine Gemeinschaft von Freiwilligen, Inhalte zu überwachen, zu diskutieren und zu korrigieren. Diese kollektive Aufsicht ist eine der stärksten Abwehrmaßnahmen der Plattform gegen Desinformation.

- Verwendung zuverlässiger Quellen: Die Inhaltsrichtlinien von Wikipedia schreiben vor, dass Informationen überprüfbar sein und auf zuverlässigen, veröffentlichten Quellen basieren müssen. Das trägt dazu bei, die Verbreitung von unbestätigten oder irreführenden Informationen zu verhindern.

- Proaktive Moderation: Wikipedia setzt eine Kombination aus automatisierten Tools, wie etwa Bots und Machine-Learning-Modellen und menschlichen Prüfungen ein, um Vandalismus, voreingenommene Bearbeitungen und Desinformationsversuche in Echtzeit zu erkennen und rückgängig zu machen.

Diese Grundlagen sind unerlässlich, um die Risiken der digitalen Enzyklopädie in einer Welt der Desinformation zu minimieren, aber sie sind nicht unumgänglich. Wikipedia stand in den letzten Jahren einer Reihe großer Herausforderungen gegenüber:

- Es gab Versuche der „Projektübernahme”, bei denen kleine, organisierte Gruppen – oft mit extremistischen oder nationalistischen Zielen – das Ziel haben, die redaktionelle Kontrolle zu übernehmen. Der Fall der kroatischen Wikipedia (2011–2020) ist ein eindrucksvolles Beispiel dafür, wie rechtsextreme Gruppen versuchten, die Geschichte umzuschreiben, Anti-LGBT-Propaganda verbreiteten und gleichzeitig abweichende Stimmen zum Schweigen brachten. Dieser Fall unterstreicht die Risiken fragmentierter Gemeinschaften und die Notwendigkeit stärkerer Schutzmaßnahmen gegen ideologische Unterwanderung.

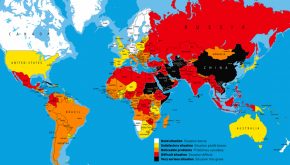

- Staatlich geförderte Manipulation durch autoritäre Regime und staatliche Akteur:innen zur Kontrolle der Narrative auf Wikipedia: Russland aber auch China oder die Türkei verhängten beispielsweise Geldstrafen und drohten mit Blockaden , weil Wikipedia über den Krieg in der Ukraine berichtete. Sie forderten auch die Entfernung von Inhalten , die den offiziellen staatlichen Narrativen widersprechen.

- Manipulationen zum Zwecke der kommerziellen Einflussnahme und Reputationsmanagement: Private Unternehmen und PR-Agenturen haben in der Vergangenheit versucht, Wikipedia zu manipulieren, um ihren Ruf zu verbessern. Der Fall Avisa Partners im Jahr 2022 enthüllte, wie eine „Reputationsmanagement”-Firma gefälschte Konten nutzte, um Wikipedia-Seiten für Kund:innen, darunter CAC 40-Unternehmen und ausländische Regierungen, zu verändern.

Auch Künstliche Intelligenz spielt eine immer größere Rolle in der Desinformationsindustrie. KI, und Informationswäsche mit dem Aufkommen von KI-generierten Inhalten, stellen neue Bedrohungen dar. Beispielsweise nutzte Portal Kombat, ein von der französischen Agentur Viginum identifiziertes Netzwerk, KI, um gefälschte Medienseiten zu erstellen, die dann als „Quellen” auf Wikipedia zitiert wurden. Diese Taktik der „Informationswäsche” nutzt die Abhängigkeit von Wikipedia von überprüfbaren Referenzen aus und erschwert es Moderator:innen, gefälschte Inhalte zu erkennen.

Die Rolle von Wikipedia im Kulturkampf

Angesichts dieser Herausforderungen ist Wikipedia nicht nur ein passiver Wissensspeicher, sondern ein aktiver Teilnehmer an den Kulturkriegen, die unser digitales Zeitalter prägen. Das Bekenntnis zu Neutralität, Überprüfbarkeit und offener Zusammenarbeit macht die Enzyklopädie zu einem Symbol demokratischer Ideale – aber auch zu einem Ziel für diejenigen, die diese Ideale untergraben wollen.

Denn Wikipedia ist eine Waffe der Demokratie: Ihr Modell offener, strukturierter Daten unterstützt die Bürgerverantwortung. Durch die Bereitstellung kostenloser, zugänglicher und überprüfbarer Informationen wirkt sie der Verbreitung autoritärer Propaganda und kommerzieller Desinformation entgegen. Wikipedia widersetzt sich der Zensur von Inhalten und hat mehrere Rechtsstreitigkeiten gewonnen – beispielsweise gegen die Blockade durch die Türkei und die Geldstrafen durch Russland. Die Weigerung der Wikimedia Foundation, ungerechtfertigten Forderungen nach Entfernung von Inhalten nachzukommen, unterstreicht ihr Bekenntnis zur redaktionellen Unabhängigkeit.

Wikipedia bleibt so ein Vorbild für digitale Resilienz: Das hybride Governance-Modell, das menschliche Aufsicht mit technologischen Tools kombiniert, bietet einen Entwurf für die Bekämpfung von Desinformation. Außerdem ist Wikipedia ein Ort für Innovation.

Der Wikipedia Sensitivity Meter: Ein proaktives Tool zur Erkennung von Schwachstellen

Der Wikipedia Sensitivity Meter ist ein fortschrittliches Analyse-Tool, das von Wikimedia France und opsci.ai entwickelt wurde, um die Anfälligkeit von Wikipedia-Artikeln für Desinformation, Manipulation und redaktionelle Voreingenommenheit zu messen.

Das vom PROMPT-Projekt unterstützte Tool bewertet die Anfälligkeit von Seiten, indem es ungewöhnliche Muster in Bezug auf drei Metriken erkennt:

- Heat Risk: Bewertet die Intensität der Aktivität und die Sensibilität einer Seite. Ein plötzlicher Anstieg der Seitenaufrufe oder Bearbeitungen kann auf Manipulationsversuche oder ein erhöhtes öffentliches Interesse hindeuten, wie im Fall zahlreicher Versuche, Seiten estnischer Politiker Anfang 2026 zu manipulieren.

- Verhaltensrisiko: Deckt Manipulationen durch die Analyse des Verhaltens von Mitwirkenden auf – beispielsweise Nutzer:innen mit gefälschten Konten, die (manchmal koordinierte) Bearbeitungen vornehmen.

- Qualitätsrisiko: Verwendet Wikimedia-basierte Metriken, um die Zuverlässigkeit und Robustheit von Inhalten zu bewerten. Es untersucht dafür Seiten, denen Quellen fehlen, die sich auf zu wenige Quellen stützen oder Wikipedia-Referenzen mit auf der schwarzen Liste stehenden Quellen enthalten, zum Beispiel russische Websites des Pravda-Netzwerks.

Example: Wikipedia Sensivity Meter applied to Brigitte Macron’s French, English and German Wikipedia pages.

Alle diese Metriken sind in Echtzeit in 45 Sprachen für Wiki-User:innen sowie Journalist:innen und Analyst:innen verfügbar, um potenzielle Bedrohungen bei ihrem Auftreten zu verfolgen und so ein schnelles Eingreifen zu ermöglichen.

In seiner größeren Version – dem Wikipedia Sensitivity Barometer – bietet das Tool eine Makro-Sicht auf Desinformationsrisiken in großen Datensätzen von Wikipedia-Seiten. Dabei kommen benutzerfreundliche Funktionen und Grafiken zum Einsatz. Besonders thematische Cluster wie Seiten zu Wahlen, geopolitischen Fragen oder anderen kontroversen Themen lassen sich so gut überwachen Dort sind koordinierte Desinformationskampagnen besonders wahrscheinlich.

The Wikipedia Sensivity Barometer – Moldovan 2025 parliamentary elections.

Der Weg in die Zukunft: Wikipedia in einer postfaktischen Welt schützen

Um die Rolle als vertrauenswürdige Wissensquelle zu erhalten, muss Wikipedia sich weiter anpassen und Innovationsgeist zeigen. Zu den wichtigsten Strategien gehören:

- Die Stärkung der Community-Governance: Ausweitung von Moderationsschulungen, um Freiwilligen dabei zu helfen, raffinierte Manipulationstaktiken wie KI-generierte Desinformation und koordinierte Sockpuppet-Netzwerke zu erkennen. Dabei geht es auch darum, die Vielfalt der Beiträge zu fördern, um ideologische Vereinnahmung zu verhindern und Pluralismus in den Inhalten zu gewährleisten.

- Entwicklung und Konsolidierung von Tools wie dem Sensitivity Meter und dem Barometer, um Echtzeit-Analysen zu Desinformationsrisiken zu liefern.

- Politische Interessenvertretung: Zusammenarbeit mit EU-Institutionen, um sicherzustellen, dass Vorschriften wie der Digital Services Act (DSA) eine dezentrale Governance unterstützen und freiwillige Mitwirkende vor rechtlicher Schikane schützen.

- Eintreten für Transparenz in der KI, indem von KI-Modellen verlangt wird, dass sie ihre Quellen offenlegen und die Prinzipien der Transparenz von Wikipedia respektieren.

- Verbesserung der Zusammenarbeit innerhalb des erweiterten Wikipedia-Ökosystems: Partnerschaft mit Faktenprüfungsorganisationen, akademischen Einrichtungen und Regierungsbehörden wie zum Beispiel Viginum in Frankreich, um Informationen über Desinformationskampagnen auszutauschen; und Unterstützung lokaler Wikimedia-„Sektionen” in Hochrisikoregionen, um Widerstandsfähigkeit gegen staatliche Zensur und politische Einmischung aufzubauen.

Fazit: Wikipedia als Vorbild für digitale Widerstandsfähigkeit

In einer postfaktischen Zeit und inmitten eines Kulturkampfes kann Wikipedia ein Leuchtturm des Vertrauens sein – eine Plattform, auf der kollaborative Governance Vorrang vor algorithmischer Kontrolle hat. Ihr anhaltender Erfolg hängt jedoch von Wachsamkeit, Innovation und globaler Solidarität ab. Durch die Stärkung ihrer Abwehrkräfte, ihrer Community und durch das Eintreten für offen verfügbares Wissen kann Wikipedia in einer zunehmend polarisierten und manipulierten digitalen Welt ein Zufluchtsort für zuverlässige Informationen bleiben.

Da Desinformationstaktiken immer raffinierter werden, werden Tools wie der Sensitivity Meter und das Barometer für die Wahrung der Integrität von Wikipedia unerlässlich sein. Ihr Erfolg zeigt die Leistungsfähigkeit kollaborativer, datengestützter Ansätze zum Schutz digitaler öffentlicher Räume – Erkenntnisse, die in umfassendere Bemühungen zur Bekämpfung von Online-Desinformation einfließen können.

Schlagwörter:Desinformation, KI, künstliche Intelligenz, LGBTQ, Plattform, PROMPT, Wikimedia, wikipedia