Internet-Plattformen sind innovativ und gewinnen im immer mehr an Einfluss. Ihr Erfolg produziert jedoch auch Risiken und führt zu umstrittenen Regulierungen.

Handys, Internet und Social Media haben die gesellschaftliche Informations- und Kommunikationsstruktur in nur wenigen Jahren revolutioniert. Internet-Nutzern steht heute eine Vielzahl an Informationen und Quellen zur Verfügung. Für Anbieter und Sprecher war es noch nie so einfach Zugang zur Öffentlichkeit zu erlangen, um Informationen und Meinungen zu verbreiten. Resultat ist eine nie dagewesene Angebots- und Informationsvielfalt, die mitunter zu einem „information overload“ führen kann.

Handys, Internet und Social Media haben die gesellschaftliche Informations- und Kommunikationsstruktur in nur wenigen Jahren revolutioniert. Internet-Nutzern steht heute eine Vielzahl an Informationen und Quellen zur Verfügung. Für Anbieter und Sprecher war es noch nie so einfach Zugang zur Öffentlichkeit zu erlangen, um Informationen und Meinungen zu verbreiten. Resultat ist eine nie dagewesene Angebots- und Informationsvielfalt, die mitunter zu einem „information overload“ führen kann.

Vor allem den großen Internet-Plattformen wie Facebook, Twitter, Google und Amazon ist es gelungen, mit innovativen technologischen Lösungen Orientierungsprobleme zu reduzieren. Mit Hilfe von Algorithmen werden Werbung und Inhalte entsprechend der prognostizierten Nutzerinteressen kuratiert. Sprecher und Publikum, Angebot und Nachfrage sollen gezielt miteinander verbunden werden. Die Automatisierung, Skalierbarkeit und die Effektivität der Vermittlungsleistung machen einen Teil des Erfolges der Internet-Plattformen aus.

Die Annehmlichkeiten und der Nutzen von automatisierten algorithmischen Anwendungen stellen jedoch nur eine Seite der Medaille dar. Die Kehrseite bilden etliche Risiken, die mit der zunehmenden Verbreitung von Internet-Plattformen einhergehen. Dabei wird auch die Liste demokratischer Kollateralschäden immer länger.

Irreführung und Manipulation

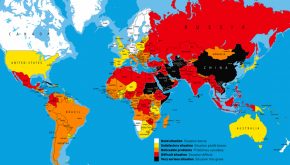

Für demokratische Prozesse ist korrekte und vertrauenswürdige Information essentiell, aber das Internet und Social Media sind anfällig für Irreführung, Manipulation und Verzerrungen. Beispielhaft dafür ist computerbasierte, automatisierte Propaganda mit Hilfe von Desinformation (Fake News) und Social Bots, die in politischen Kampagnen zum Einsatz kommen, um die öffentliche Meinung zu beeinflussen. So imitieren Social Bots menschliches Verhalten in sozialen Netzwerken, um Anhängerzahlen und Zustimmung künstlich in die Höhe zu treiben und einen falschen Eindruck der Popularität von Personen und Meinungen zu vermitteln. Forscher am Oxford Internet Institut fanden 2018 in 48 Ländern formal organisierte Social-Media-Manipulation durch politische Partien und Behörden und sprechen bereits von einer florierenden Beeinflussungsindustrie.

Hinzu kommen personalisierte Werbung und Microtargeting in Werbekampagnen. Ihr Einsatz für politische Werbung ist aufgrund fehlender Transparenz und selektiver Information demokratiepolitisch brisant, speziell im Fall von Dark Ads, die nur von den direkt Angesprochenen selbst gesehen werden. In anderen Fällen von Online-Werbung sind Auftraggeber, Motivation und Finanzierung der Werbung für Nutzer nicht klar erkennbar. Die Anfälligkeit für Manipulation und Wählertäuschung steigt.

Filterblasen, Polarisierung und Hass

Als mögliche Folge der automatisierten Selektion auf Internet-Plattformen gilt auch die Bildung von Filterblasen. Eli Pariser hat in seinem vielbeachteten Buch „The Filter Bubble“ davor gewarnt, dass die Verbreitung von Informationen immer stärker auf die bereits vorhandenen Interessen der Nutzer abgestimmt wird. Der Spielraum zur Entdeckung von Neuem wird verengt und einzelne Nutzer bleiben in ihrer Filterblase gefangen. Passgenaue Vorgaben und Empfehlungen durch automatisierte Selektion führen zu einer Zersplitterung der gesellschaftlichen Debatten und zu Polarisierung, weil wir jeweils nur an individuelle Interessen und Meinungen angepasste Informationen erhalten. Ein gemeinsames, von vielen geteiltes Informationsangebot als Voraussetzung für breite Diskurse und Öffentlichkeit und als Grundlage für Demokratie könnte verloren gehen.

In verschiedenen wissenschaftlichen Untersuchungen konnte der Filterblaseneffekt jedoch empirisch nicht pauschal bestätigt werden. Studien zeigen, dass Social-Media-Nutzer meist vielfältige Quellen verwenden und dass Filterblasen nicht die Norm auf sozialen Netzwerken darstellen und überschätzt werden. Für einzelne Nutzer und gesellschaftliche Gruppen mit spezifischem Nutzungsverhalten erscheinen Filterblaseneffekte jedoch durchaus möglich. In einer weiteren aktuellen Untersuchung wurde zum Beispiel gezeigt, wie der Empfehlungsalgorithmus von YouTube zur Vernetzung und Bildung einer Filterblase rechter politischer Bewegungen in den USA beiträgt.

Technik und Algorithmen sind auch mitverantwortlich für die Verbreitung von Wut, Hass und Provokation in sozialen Netzwerken. Dabei handelt es sich um Inhalte, die stark emotionalisieren. Diese lösen stärkere Reaktionen in Form von Zustimmung oder Ablehnung aus, die wiederum von Algorithmen als Indikator für eine hohe Relevanz der Postings herangezogen werden. Deshalb werden solche Postings dann noch mehr Nutzern angezeigt und ihre Verbreitung technisch weiter verstärkt. „Wer aufregt und viel Reaktionen auslöst, wird mit Reichweite belohnt“, sagt Ingrid Brodnig, die sich intensiv mit Hass im Internet beschäftigt. Betroffene Personen und Gruppen leiden darunter ebenso wie die Qualität der öffentlichen Debatten, die auf Internet-Plattformen geführt werden.

Marktmacht und Abhängigkeiten

Heute wird ein großer und steigender Anteil an Kommunikation und Handel über einige wenige Plattformen im Internet abgewickelt. Die Marktmacht der Plattformen führt zu Abhängigkeiten für Produzenten, App-Entwickler, Händler, Werbetreibende und auch die Anbieter von Inhalten. Sie sind auf die Verbreitung ihrer Dienste und Informationen auf Internet-Plattformen angewiesen, und diese Abhängigkeit kann sich rasch zu Lasten von Medien auswirken. So verlor beispielsweise das österreichische Online-Satiremagazin Die Tagespresse laut eigenen Angaben ein Drittel an Zugriffen, seit Facebook durch eine Änderung am Algorithmus den Meldungen von Freunden mehr Relevanz beimisst als jenen von Unternehmen und Medien.

Weiters führt auch die starke Nutzung von Internet-Plattformen zu vielfältigen Auswirkungen im Mediensektor. Der wirtschaftliche Erfolg der Plattformen resultiert vor allem aus dem Erfolg am Werbemarkt. Programmatische Werbung, verhaltensbasierte Internet-Werbung und Microtargeting sind Bezeichnungen für Werbeformen, die eine starke Personalisierung von Werbung im Internet ermöglichen und damit die Optimierung von Werbekampagnen fördern. Für diese Werbeformate verfügen Suchmaschinen und Social Media über massive Wettbewerbsvorteile, weil sie für personalisierte Werbeformen auf ihre enorme Fülle an Nutzerdaten zurückgreifen können. Der Erfolg dieser Werbeformen ist mitverantwortlich für sinkende Werbeumsätze der traditionellen Medien und eine der Ursachen für die Finanzierungskrise im Journalismus. Für Verleger wird es immer schwieriger, Journalismus und damit auch demokratische Kontrollfunktionen zu finanzieren.

Regulierung durch Politik und Plattformbetreiber

Die Beispiele zeigen einige der Risiken des Aufstiegs der Internet-Plattformen für Medien, Öffentlichkeit und Demokratie. Plattformbetreiber spielen ihre Rolle dabei gerne herunter, sehen sich primär als Technologiedienstleister und lehnen eine unmittelbare Verantwortlichkeit, vor allem für Inhalte Dritter ab. Doch mit den Datenschutzskandalen, dem Manipulationsverdacht bei den US-Präsidentschaftswahlen und der Zunahme von Hass im Rahmen der Flüchtlingskrise in Europa gelangen die Risiken stärker ins öffentliche Bewusstsein und führen zu regulatorischen Reaktionen.

So versuchen Plattformbetreiber mit komplexen Kontrollsystemen gegen Manipulation und Hass vorzugehen. Sie etablieren Community Standards, automatisierte Verfahren sowie menschliche Kontrollen und experimentieren mit künstlicher Intelligenz, um problematische Beiträgen zu identifizieren, zu filtern, zu löschen oder weniger prominent darzustellen. Gleichzeitig verschärfen auch Staaten die regulatorischen Vorgaben, wie beispielsweise mit dem Netzwerkdurchsetzungsgesetz in Deutschland oder der Reform des Urheberrechts und der Einführung des Leistungsschutzes auf EU-Ebene. Damit soll beispielsweise die Haftung für Uploads durch Nutzerinnen und Nutzer in Zukunft bei den großen Plattformen liegen. Sie müssen effiziente und proportionale Maßnahmen ergreifen, um Urheberrechtsverletzungen zu verhindern. So werden Plattformen stärker in die Verantwortung genommen und das Prinzip der Haftungsprivilegierung erodiert.

Gut gemeint oder gut gemacht?

Solche regulatorische Initiativen zielen unter anderem darauf ab, öffentliche Kommunikation und demokratische Öffentlichkeit vor Hass und Manipulation zu schützen sowie die Leistungen von Medien und Kulturschaffenden adäquat zu vergüten. Sie sind daher bestimmt „gut gemeint“. Zweifel gibt es jedoch, dass die Umsetzung auch „gut gemacht“ wird. Denn stark zentralisierte, vorwiegend technische Lösungen wie Upload-Filter sind nicht sensibel für die Kontexte, in denen Inhalte verwendet werden, z.B. für Satire. Sie bergen deshalb die Gefahr fehlender Treffsicherheit und führen ihrerseits zu Risiken für Demokratie und Öffentlichkeit, speziell für die Meinungsfreiheit. Eingriffe durch Kuratierung, Moderation und Filterung wirken regulierend auf gesellschaftliche Information und Kommunikation.

Vielfach wird kritisiert, dass die damit verbundene Macht unkontrolliert in den Händen der Plattformbetreiber liegt. Der Weg vom Problem führt durch die vorgeschlagene Lösung schnell zu neuen Risiken – und der Grat für adäquate Regulierung ist äußerst schmal. Darum besteht ein zunehmender Bedarf an einer breiten Debatte zur Frage der Verantwortung von Internet-Plattformen für Öffentlichkeit und Demokratie.

Das Institut veranstaltet am 5./6. Oktober 2018 gemeinsam mit dem Institut für Innovation und Digitalisierung im Recht eine Tagung zum Thema „Regulierung von Internet-Plattformen“ in der Sky Lounge der Universität Wien, Oskar- Morgenstern-Platz 1. Der Eintritt ist frei.

Erstveröffentlichung: derstandard.at vom 2. Oktober 2018

Bildquelle: pixabay.com

Schlagwörter:Algorithmen, Desinformation, Fake News, Filter Bubble, Filterblase, Internet-Plattformen, Microtargeting, soziale Netzwerke