Künstliche Intelligenz-Technik (KI) verändert gegenwärtig unsere Gesellschaft ähnlich massiv wie einst der Computer oder das Auto. Journalisten müssen solche Veränderungen beobachten und kritisch hinterfragen. Doch beim Thema KI vernachlässigen sie dies oft.

Das hat häufig einen banalen Grund, manche geben das auch zu: Ihnen graut seit Schultagen vor Mathematik. Und KI oder Algorithmus klingt nach ganz viel Mathe. Lange wähnten sie sich sicher, im Journalismus ohne sie auszukommen. Das ist vorbei, heute passt in diesen Beruf nur, wer sich mit „der Zahl“ versöhnt. Das ist nicht schwieriger, als sich in sonst ein Thema einzuarbeiten.

Das hat häufig einen banalen Grund, manche geben das auch zu: Ihnen graut seit Schultagen vor Mathematik. Und KI oder Algorithmus klingt nach ganz viel Mathe. Lange wähnten sie sich sicher, im Journalismus ohne sie auszukommen. Das ist vorbei, heute passt in diesen Beruf nur, wer sich mit „der Zahl“ versöhnt. Das ist nicht schwieriger, als sich in sonst ein Thema einzuarbeiten.

Medien sind von KI mehrfach betroffen: das Reuters-Instituts der Universität Oxford beschreibt die KI-Technik als im Strategieplan vieler Medienhäuser wesentlichen Innovationstreiber. Sie verändert die Arbeit der Journalisten massiv: Automatisierte Textsysteme nehmen ihnen Routinemeldungen ab; automatisierte Empfehlungssysteme messen, was wer im Publikum wann und in welcher Situation gerne liest. Die KI-Technik wirkt in alle gesellschaftlichen Bereiche und in jede Branche hinein: bei der Empfehlung für Beförderungen im Job oder wenn es um Kreditwürdigkeit, unsere Gesundheit, unsere Privaträume geht. KI-Technik und ihre Folgen sind ein Dauerthema von höchster Bedeutsamkeit geworden.

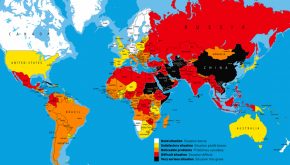

Auch deshalb irritiert mich, wenn noch immer viele (nicht alle natürlich!) Journalisten KI (und weitere Innovationen) lieber als eine Blackbox darstellen, in die kaum einer reinblicken kann, als eine Art Dämon, der uns bedroht und aufregt. Als Microsoft vor ein paar Jahren den Chatbot Tay einsetzte, der rasch nicht mehr wie geplant die Jugendkultur studierte, sondern von einem Teil der Netzgemeinschaft zu einem unflätigen Rassisten gemacht wurde, gab es (zu Recht) viel Empörung, aber leider wenig Kontext: Warum ist das technisch möglich, wann wirkt Technik diskriminierend? Viele Medien reduzieren in ihren Berichten KI-Fortschritt auf den Wettkampf Mensch gegen Maschine, den „wir“ nun immer öfter verlieren. Doch ist es ja gerade nicht das Problem, ob eine Maschine eine Aufgabe schneller oder ausdauernder leistet. Entscheidend ist, dass wir ihre Leistung uns zu Diensten machen. Und diskutieren, wie wer wem endlich Verantwortung zuweisen sollte – zum Beispiel für Codierfehler und Trainierfehler in den Daten. Wer ist verantwortlich, wenn eine Gesichtserkennungssoftware Dunkelhäutige schlecht erkennt? Der Programmierer? Der Auftraggeber? Der Nutzer?

KI-Technik ist weder intelligent noch gemein noch hat sie einen eigenen Willen. KI-Technik ist eine weiterentwickelte Art von Automatisierung, die auf der Basis von Regeln in diversen Kontexten die wirkungsvollste Aktion auswählt. Sie folgt einer Handlungsvorschrift für die Lösung eines Problems, einem Algorithmus. Dieser Basisbegriff aus der Mathematik ist so prominent und präsent geworden, dass wohl kaum mehr Zweifel besteht: Ähnlich wie Schreiben ist auch Mathematik von jeher eine Kulturtechnik und essentiell für sachgerechten Journalismus. Wie peinlich, Bevölkerungszuwächse mit den Absolutzahlen zu verwechseln! Sachgerechter Journalismus schließt eine versöhnte Haltung zur „Zahl“ ein. Es ist schlicht eine Frage der Arbeitshaltung, sich auf Themen einzulassen, sich einzuarbeiten. Das sind klassische journalistische Arbeitsroutinen. Nur wer genügend weiß, kann differenziert berichten und kritisch fragen: Wie wurde der Datensatz zusammengestellt? Wird z.B. eine Gesichtserkennungssoftware ausschließlich an Beispielen von Menschen mit heller Haut trainiert, dann liefert sie bei mit dem ihr bekannten Merkmal „helle Haut“ kombinierten Varianten deutlich bessere Ergebnisse als bei Personen mit dem ihr nicht bekannten Merkmal „dunkle Haut“. Nicht nur Technik- und Datenjournalisten, alle Journalisten müssen die Grundlagen von Programmierung kennen. Sie müssen nicht programmieren können. Wer über Autos schreibt, muss auch keine bauen können, wer über Operationstechniken berichtet, nicht operieren.

Wer das Prinzip algorithmisierter Prozesse begreift, entdeckt auch die Chancen, sie zum Wohl der Menschen zu nutzen. Man kann z.B. nicht nur Erlös-Faktoren, sondern auch Normen des Public Service-Auftrags (Relevanz, Vielfalt, Transparenz) als Kriterien vorgeben, nach denen dem Publikum Texte empfohlen werden. Qualitätssiegel könnten Herkunft und Güte von Daten sichtbar machen.

Wir alle müssen uns aussöhnen mit KI-Technik und uns darauf einigen, welche Art von Nutzung und von Kontrolle wir für gesellschaftlich angemessen finden.

Interessante Links:

Nichtregierungsorganisation, die sich mit Algorithmenethik befasst: Algorithmwatch. https://algorithmwatch.org/de/

Nic Newman (2018): Journalism, Media and Technology Trends and Predictions 2018. Hrsg. vom Reuters Institut der Universität Oxford. http://reutersinstitute.politics.ox.ac.uk/our-research/journalism-media-and-technology-trends-and-predictions-2018

Erstveröffentlichung: Schweizer Journalist 10-11/2018

Bildquelle: pixabay.de

Schlagwörter:Algorithmen, Innovationen, KI, künstliche Intelligenz, Mathematik