In anderen Regionen Europas bereits länger etabliert, existiert inzwischen auch für Deutschland und Österreich ein EU-gefördertes Faktencheck-Netzwerk. Dabei arbeiten Redaktionen und Forschung direkt zusammen. Im Gespräch mit EJO-Redakteur Marcus Kreutler geben zwei Beteiligte einen Einblick in die Arbeitsweise und die Ziele des GADMO-Netzwerks: Christina Elmer, Professorin am Dortmunder Institut für Journalistik und eine der Koordinatorinnen des Projekts, und Kian Badrnejad, Faktencheck-Redakteur bei der dpa.

Im hybriden Doppel-Interview: Christina Elmer in ihrem Büro, Kian Badrnejad zugeschaltet. (Foto: Marcus Kreutler)

GADMO, das German-Austrian Digital Media Observatory, gibt es seit November 2022. Wer kooperiert da, und mit welchem Ziel?

Christina Elmer: Im GADMO-Projekt kooperieren wir an der TU Dortmund mit Faktencheck-Redaktionen: derdpa, der APA, der AFP, und mit Correctiv, die sich im deutschsprachigen Raum dem Thema sehr verschrieben haben. Die kommen bei uns zusammen und publizieren auf einer gemeinsamen Plattform Faktenchecks. Wir bauen damit ein großes, öffentliches Archiv auf, um den Zugang zu Faktenchecks zu erleichtern. Zudem etablieren wir ein Monitoring, inwiefern die Plattformen ihren Selbstverpflichtungen gerecht werden, gegen Desinformationskampagnen vorzugehen. Von Seiten der Forschung untersuchen wir die Verbreitung von Kampagnen und mögliche Werkzeuge zur besseren Identifikation und Erkennung von Falschinformationen. Wir sind dabei nicht die einzigen, die Forschung betreiben in dem Projekt: Das machen wir zusammen mit dem Austrian Institute of Technology, das sich vor allem auf die KI-unterstützte Analyse von multimedialen Inhalten spezialisiert hat. Also darauf, ob Bilder und Videos manipuliert sein könnten und mit welchen Werkzeugen man Hinweise finden kann, was man sich noch einmal genauer anschauen muss.

Kian Badrnejad: Die Arbeit rund um Desinformation und das Faktenchecken an sich sind, auch im Unterschied zu vielen anderen Bereichen im Journalismus, ein sehr kollaboratives Geschäft. Man arbeitet sowieso oft zusammen, hilft sich gegenseitig auch über Organisationsgrenzen hinweg. Wir haben aber gemerkt, dass wir als Faktenchecker oft ganz gut auf internationaler Ebene vernetzt sind – aber noch gar nicht so sehr innerhalb des deutschsprachigen Raums. Dasselbe gilt auch für den wissenschaftlichen Bereich. Da ist es nun toll, dass wir eine Förderung für eine Struktur bekommen, mit der wir das ausbauen können. Hier können wir ausprobieren, wie man in diesem Bereich mit seiner großen gesellschaftlichen Relevanz besser zusammenarbeiten kann. Es geht schließlich darum, der Gesellschaft eine solide Basis an Fakten und Informationen zu liefern, auf der sie dann Entscheidungen treffen kann.

Elmer: Das ist auch unsere langfristige Vision. Wir hoffen, dass wir nach den ersten 30 Monaten Projektlaufzeit eine Anschlussförderung bekommen, um dieses Netzwerk am Leben halten zu können. Es weist ja auch über den deutschsprachigen Raum hinaus, denn wir sind eingebunden in den europaweiten Verbund EDMO (European Digital Media Observatory) aus insgesamt 14 Hubs. Dort sind alle Mitgliedstaaten abgedeckt, so dass wir über Aktivitäten innerhalb des Netzwerks sehr gut Inhalte, Methoden und Strategien austauschen können.

Beteiligt sind ja unter anderem mehrere Nachrichtenagenturen, die als Organisationen eben auch konkurrieren. Wie funktioniert das? Gibt es jetzt Themenabsprachen, damit nicht verschiedene Teams am gleichen Thema recherchieren?

Badrnejad: Grundsätzlich arbeiten wir weiter unabhängig voneinander, das ist ein ganz wichtiges Prinzip bei dem Projekt. Wir sehen es gerade nicht als Problem, sondern eher als einen Gewinn, wenn wir immer wieder auch gleichzeitig am selben Thema arbeiten. So können wir hinterher sehen, welche Recherchewege jeder gegangen ist, ob wir vielleicht auch mal zu unterschiedlichen Ergebnissen gekommen sind. Da ist mir zum Glück gerade kein Beispiel bekannt, wo das signifikant so war. Dass wir da immer wieder abgleichen können, ist eine gute zusätzliche Qualitätskontrolle. Wichtig ist Zusammenarbeit in anderen Bereichen: Dass wir uns austauschen können, welche Themen überhaupt unterwegs sind und dass wir uns Hinweise zu Recherchewegen oder Tools geben können. Da ist es von Vorteil, dass wir beim Thema Faktencheck nicht konkurrieren, weil es genug zu tun gibt.

Wie sieht denn der Alltag im Projekt aus?

Elmer: Große Projekttreffen haben wir regelmäßig, tauschen uns aber auch im Alltag sehr intensiv aus. Dafür haben wir einen gemeinsamen Slack-Workspace. In den Forschungsteams koordinieren wir die Zusammenarbeit eher anlassbezogen, etwa wenn wir gemeinsam am selben Datensatz arbeiten oder ein Paper zusammen schreiben. Kian, wie ist das bei euch?

Badrnejad: Wir schalten uns alle ein bis zwei Wochen zu einem regelmäßigen Jour Fixe zusammen, wo es um organisatorische und manchmal technische Dinge geht. Wir haben ja eine gemeinsame Homepage mit einem großen Faktencheck-Archiv, das umfangreich verschlagwortet und kategorisiert ist. Wir stimmen uns zum Beispiel immer wieder darüber ab, welche Kategorien wir einführen und vielleicht auch wieder rausnehmen.

Dann tauschen wir uns natürlich aus, ob wir Trends sehen: Bereiche, in denen besonders viele Desinformation und Falschbehauptungen – wir nennen das Claims – auftauchen. Wir geben auch intern unsere wichtigsten Themen in eine Art Ranking ein, das wir dann auch wieder auf die gesamteuropäische Ebene spiegeln. Alle Hubs geben diese Informationen weiter und die EDMO-Zentrale wertet es aus. Das Veröffentlichen der Faktenchecks auf GADMO ist dann schließlich etwas, das eher jeder für sich macht.

Die Datenbank ist sicherlich ein zentraler Punkt, der wahrscheinlich auch die größte Breitenwirkung erzielt. Ich möchte trotzdem die anderen Tätigkeitsfelder des GADMO kurz ansprechen: Da ist zum einen der Beitrag der Forschung, gerade auch beim Stichwort KI – da zucken viele wohl eher zurück und sehen KI als mächtiges Tool, um Fake News zu erschaffen.

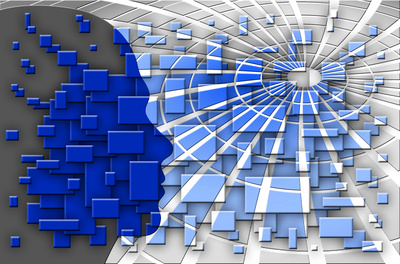

Elmer: Das mag auch so sein, aber deswegen müssen wir um so mehr daran arbeiten, dass entsprechende Tools entwickelt werden, die zumindest bei der Identifikation möglicher Fälschungen helfen können. An dieser Aufgabe arbeiten ja auch unsere Kollegen in Wien beim AIT. Wir müssen aber davon ausgehen, dass es eine Art Wettrüsten bleiben wird, und dass wahrscheinlich die KI-Werkzeuge zum Fälschen auch immer besser werden. Wir haben nicht die Hoffnung, ein hundert Prozent sicheres Tool zu entwickeln, sondern es geht eher um Assistenzsysteme.

Wir sehen schon eine Gefahr darin, dass die Werkzeuge so günstig zu haben sind und sich in einer unglaublichen Geschwindigkeit weiterentwickeln. Bislang gab es ja eine Art Video- und Bildbeweis im Online-Journalismus: Habe ich von einer Situation mehrere Bilder und Videos aus einigermaßen verlässlichen Quellen, kann ich eigentlich davon ausgehen, dass die Situation so stattgefunden hat. Da muss man jetzt sagen, dass der Wert eines solchen Belegs abnimmt. Hier müssen wir neue Wege finden. KI-unterstützte Überprüfung kann eine Möglichkeit sein, bei der Verifikation zu helfen, aber die Herausforderung reicht auch weit darüber hinaus.

Wie ist die praktische Perspektive auf das Thema KI?

Badrnejad: Das ist schon etwas, das uns Sorge macht. Nicht so sehr, weil es etwas qualitativ Neues ist: Fotos und Videos zu manipulieren, wie es mit KI passiert, war ja bislang auch möglich. Aber es geht nun so unglaublich einfach und schnell. Vorher musste ich ja zumindest grundlegende Kenntnisse in Photoshop haben, um ein Bild zu manipulieren. Inzwischen muss ich nichts mehr können außer die richtigen Prompts einzugeben und bekomme das in wenigen Minuten. Wir befürchten, dass wir irgendwann mit ganz vielen KI-generierten Inhalten geflutet werden könnten. Das ist noch nicht passiert, aber wir sind froh, dass wir auch mit wissenschaftlichen Partnerorganisationen zusammenarbeiten, die bereits jetzt Tools entwickeln, die uns hoffentlich helfen werden, mit so einer Situation umzugehen. Das Risiko ist einfach, dass diese Größenordnung irgendwann nicht mehr beherrschbar ist, wenn du nicht technische Hilfsmittel dafür bekommst. Gleichzeit sehen wir aber auch, dass bestimmte Dinge, die KI kann, natürlich auch beim Identifizieren von Desinformationen helfen. Teilweise nutzen wir sie ja schon, etwa die Auto-Übersetzung von DeepL, Google und anderen Anbietern. Die ist eine unschätzbare Hilfe bei der Recherche, auch wenn es am Ende natürlich jemand überprüfen muss, der die Sprache wirklich beherrscht. Wir hoffen, dass da noch weitere nützliche Tools dazu kommen.

Elmer: Wir hoffen auch, dass wir Muster in Datenspuren finden, die zeigen, wie sich Desinformationskampagnen verbreiten. Die Hypothese ist, dass durch die strategische Streuung und häufig die Verbreitung mit Bots spezifische Muster zu finden sein müssten. Die könnte man dann auch nutzen, um Kampagnen frühzeitig zu erkennen. Ob wir diese Frage untersuchen können, hängt aber im Moment noch davon ab, ob wir die Daten von den Plattformen bekommen, was ein Riesenproblem ist in so einem Forschungskontext: Wir haben nur 30 Monate Förderung und brauchen dann eben irgendwann die Daten, um mit ihnen zu arbeiten. Ich finde aber auch, dass man an den Faktenchecks immer wieder merkt, dass wir nicht allein mit technologischen Tools weiterkommen, sondern dass auch das ganz herkömmliche Recherche-Handwerk weiterhin wichtig bleibt. Wenn beides ineinandergreift, kann man einen guten Faktencheck machen. Das bringen die Faktenchecker ins Projekt ein und zeigen damit sehr schön, warum handgemachter Journalismus weiterhin wichtig ist.

Man könnte sich also als Vision vorstellen: Irgendwann kann erstmal eine Software die Masse der Daten sichten und dann das markieren, auf das noch einmal ein Mensch schauen sollte?

Elmer: Ja, so stellen wir uns das vor. Dass man am Ende vielleicht eine Art Alarm-System hat: Wo muss man schnell draufschauen, wo bekommen gefälschte oder manipulierte Inhalte schnell eine große Reichweite? Das ist ja auch heute schon ein wichtiger Faktor für die Faktenchecker, um zu entscheiden, welche Themen sie aufgreifen.

Im Mission Statement des GADMO findet sich auch der Punkt Medienkompetenz. Sehen wir bald dpa-Rechercheure in den Volkshochschulen?

Badrnejad: Auf die Ebene werden wir als dpa wahrscheinlich nicht gehen, weil die dpa sich als Nachrichtenagentur an andere Medien richtet und nicht direkt an die Menschen, die Medien konsumieren. Das machen aber andere bei uns im Projekt: Correctiv zum Beispiel hat im Rahmen seiner Bürgerakademie ganz viele Projekte, bei denen sie mit normalen Bürger:innen zusammenarbeiten und Medienkompetenzen vermitteln. Das werden sie auch bei GADMO wieder tun; über Online-Workshops und mit einer Faktencheck-Tagung im Rahmen eines Festivals, das im Spätsommer in Bonn stattfinden wird. Dabei können dann Menschen ganz physisch in Kontakt mit Journalistinnen und Journalisten treten. Wir als dpa haben schon länger ein Projekt, bei dem wir bestimmte Fähigkeiten an Kolleg:innen anderer Medien vermitteln: Das hieß einmal Faktencheck 21, inzwischen Faktencheck 23. Dinge, die wir dabei gelernt haben, bringen wir auch bei GADMO ein. Auch dort werden wir einen Bereich aufbauen, in dem wir Fähigkeiten an Journalistinnen und Journalisten vermitteln, die man insbesondere für die Arbeit mit Desinformationen gut gebrauchen kann. Grundsätzlich sehen wir, dass Medienkompetenz ein sehr wichtiger Bereich ist, weil man damit diesen ganzen Faktencheck-Bereich skalieren kann – je mehr Menschen die Fähigkeit erwerben, so etwas selbst zu überprüfen, umso weniger werden wir gebraucht und können uns den Fällen widmen, die wirklich schwierig sind.

Und dann hat sich das GADMO noch die Beobachtung von Plattformen und Social Media auf die Fahne geschrieben. Wie sieht das aus?

Elmer: Damit ist vor allem das Monitoring der Selbstverpflichtung der Plattformen gemeint, des Code of Practice on Disinformation. Wir sehen jetzt aber, dass Maßnahmen zurückgenommen werden, und dass die Plattformen auch mit ihren Berichten sehr unterschiedlich umgehen. Twitter hat sich aus der Selbstverpflichtung inzwischen komplett verabschiedet und Meta lockert auch bereits wieder bestimmte Maßnahmen, die in der Pandemie eingeführt wurden. Da ist es jetzt wichtig, hinzuschauen: Was passiert da eigentlich, auch im Hinblick auf Gesetze wie den Digital Services Act oder den kommenden KI Act der Europäischen Union? Grundsätzlich ist die große Frage: Wie kann man am Ende bei so einer Selbstverpflichtung überhaupt vorgehen, wenn die Netzwerke ihr nicht gerecht werden? Das muss dann später im EU-Kontext verhandelt werden. Erstmal sind wir innerhalb des EDMO-Kontextes mit dafür zuständig, das für den deutschsprachigen Raum aufmerksam zu beobachten.

Wir haben jetzt viel darüber gesprochen, wie auf das Phänomen von Falschinformationen reagiert werden kann. Gibt es denn auch irgendeine Form von Präventionsmaßnahmen, zum Beispiel mit Blick auf planbare Ereignisse wie Wahlen?

Badrnejad: Ja, das gibt es, für die Europawahlen im kommenden Jahr hat das EDMO eine Taskforce ins Leben gerufen, in die jeder der regionalen Hubs einen Vertreter oder eine Vertreterin geschickt hat. Für GADMO bin ich das. Dort versuchen wir, im Vorfeld Risiken und Akteure zu identifizieren, um dann wiederum ins Netzwerk zu spiegeln, wo man besonders hinschauen muss. Das ist natürlich eine enorme Herausforderung, weil sich der Bereich so schnell weiterentwickelt, die Akteure wechseln, und auch die Rolle bestimmter Plattformen sich verändert. Wir hoffen, dass wir da einen Beitrag leisten können, aber das wird spannend.

Elmer: Es gibt vom EDMO jeden Monat ein Briefing, in dem die wichtigsten Desinformations-Kampagnen dargestellt werden, die länderübergreifend laufen. So bekommt man jeden Monat einen Überblick über das aktuelle Desinformationsgeschehen. Und das kann für die Länder, in denen diese Kampagnen noch nicht angekommen sind, natürlich auch ein Vorwarninstrument sein.

Das EDMO kam jetzt schon häufiger zur Sprache. Wie fügt sich das GADMO denn ins EDMO ein?

Elmer: Das EDMO wird zentral betrieben und hat auch eine Förderung für das Gesamtmanagement im European University Institute in Florenz. Dort werden auch diese Arbeitsgruppen organisiert, von denen Kian gerade gesprochen hat. Das EDMO funktioniert also über die einzelnen Hubs hinaus. Aber im Alltag ist im Hub selbst erstmal sehr viel mehr los, schon weil wir jeden Tag neue Faktenchecks veröffentlichen, forschen und die Aktivitäten der Plattformen im Blick behalten müssen.

Badrnejad: Eine gute Parallele ist eigentlich die ARD in Deutschland: So ähnlich funktioniert es bei uns auch. Man hat eine übergeordnete Struktur, die viel organisiert und dafür sorgt, dass es einen zentralen Kanal gibt. Die inhaltliche Arbeit passiert aber jeweils in den einzelnen Anstalten. So wie ja auch der ARD-Inhalt beispielsweise vom Norddeutschen Rundfunk oder vom Bayerischen Rundfunk produziert wird, kommen die eigentlichen Inhalte bei EDMO fast alle aus einem der Hubs wie GADMO. Aber da ist eben auch eine Struktur, die diese ganzen Inhalte immer mal wieder in Überblicksformate gießt. Da gibt es etwa einen Überblick zu Faktenchecks aus ganz Europa zum Thema Ukraine-Krieg, insgesamt sollen die Texte aus allen Hubs in einer Datenbank landen – ein einzigartiger Fundus zu dem Thema.

Seit einer Weile schon machen wir eine Fact-Checking-Map: Alle Hubs melden einmal pro Monat einen wichtigen Inhalt, an dem sie gearbeitet haben. Dann kann man auf einer interaktiven Europa-Karte sehen, was bei den jeweiligen Partnern am wichtigsten war. Das ist manchmal total spannend: Neulich ging es um eine – gar nicht existierende – radioaktive Wolke, die angeblich Richtung Westen zieht, weil ein Munitionslager in der Ukraine getroffen worden war. Das war unser Inhalt, und dann haben wir gesehen, dass unsere polnischen Partner das ebenfalls veröffentlicht hatten. Und zwar etwas früher als wir, weil diese Desinformation genau wie die erfundene Wolke von der Ukraine über Polen nach Deutschland gezogen ist. Es ist alles total logisch, aber es ist schön, das wirklich zu sehen und bestätigt zu bekommen.

Schlagwörter:Fake News, Faktencheck, Forschungsprojekt, GADMO, Medienkooperation